【音频专题】“联合国是唯一值得信赖的人工智能治理全球协调机构”——专访中科院专家曾毅

“如果说人工智能带来的突破和用户体验是前所未有的,那么它的风险目前来看也是前所未有的”,这是曾毅对现阶段人工智能发展的基本判断。

近段时间以来,他先后在联合国安理会、全球人工智能安全峰会以及世界互联网大会等重要场合积极发声,分享对于全球人工智能治理的思考,并参与撰写了由世界互联网大会发布的《发展负责任的生成式人工智能研究报告及共识文件》。

在北京接受《联合国新闻》的采访时,他引用了现代控制论奠基人诺伯特·维纳(Norbert Wiener)的一句话:“我们最好非常确定,我们想让机器干的事情是我们原本的意图”。

面对如今生成式人工智能“演进速度之快、赋能范围之广、影响程度之深”的状况,曾毅甚感担忧。他对人工智能的发展程度持理性和审慎的态度,并切身感受到在全球层面协调人工智能治理的紧迫性,同时希望联合国在此方面发挥出关键作用。

(出于篇幅和行文的需要,采访内容有所编辑。)

联合国新闻:您研究的方向实际上叫做类脑人工智能,这跟目前大火的生成式人工智能之间有没有某种关系?

曾毅:其实我觉得现在生成式人工智能的发展并没有跳出原有的人工智能发展的路径,就是它仍然是基于大规模的数据,用数学的优化方法去拟合一个函数来达到目的,让系统能够输出所期望的结果,所以我把它叫做数据驱动的人工智能。

而类脑人工智能,我把它叫做机制驱动的人工智能。大脑也是一个神经网络,它是在自然演化的过程当中形成的,它的学习机制跟现在人工智能的训练算法其实还是有本质的不同。

你说它们之间是不是有关联呢?那么自然演化的过程当中,大脑的结构也接触了很多不同的数据,但是它不仅仅是一个学习的过程。

所以发展类脑人工智能,它是科学意义上在构造具有真智能的智能体;而目前的生成式人工智能的发展,其实它还是构造看似智能的信息处理的工具。

联合国新闻:那您如何来看待现在生成式人工智能的这种突飞猛进?

曾毅:作为一个信息处理的工具,(生成式)人工智能的产业希望我们把它看作是有智能的,但其实它还不是有真正的智能。你可以说,到了去年年底、今年年初,基本上它在输出和对话的模式方面确实很接近人类了。这是技术的组合优化,是用户体验的极大提升。但是,其实科学上突破智能的本质,这还是需要挺长时间的探索。

近期我注意到,不管是硅谷的一些公司,还是来自于学术界的声音,都在讨论人工智能产业是不是已经达到了通用人工智能的阶段。其实我对此还是比较担忧的,因为生成式人工智能现在慢慢在往多任务发展,它不像原来的人工智能是专一任务的。

多任务人工智能跟我们说的通用人工智能还有极大的距离。但是,以前你构造一个人工智能系统软件,需要长期的专业化训练;现在以一种通过对话的方式,就能够在生成式人工智能平台上生成一个软件了,一般用户不太有专业的素养来避免相关风险。

联合国新闻:您刚才提到了通用人工智能,或者叫做人工智能的通用性,是不是它所代表的威胁才是最大的?

曾毅:首先,在人工智能作为一个学科提出的时候,实际上它的愿景就是通用人工智能。

我们回到1956年的达特茅斯会议,当时的与会者给出了人工智能的一个公共的定义:如果人类学习或者智能的方方面面都能够被精确的描述,以至于一个计算机能够去模拟它的话,那我们就认为这样的系统叫做人工智能。什么叫方方面面?那实际上就是达到真正的通用性。

应该可以说,在人工智能的发展路径当中,其作为社会可能的准成员、社会伙伴的愿景,慢慢地就已经凸显出来了。很多人说,人工智能只能停留在工具的阶段。但是在我看来,为了给人类提供更好的辅助,实际上通用人工智能甚至超级智能的探索不会停止。

通用人工智能可能对人类造成的挑战在于,如果它想去制定规则,如果它觉得人类在这个地球上是多余的,那么这个时候它确实会对人类的生存造成根本性的挑战。我们现在可以这样说,生成式人工智能再往上进一步发展的时候,这种隐患就已经存在了。

在我看来,要解决通用人工智能对于人类的根本挑战,需要的答案不一定能够在四、五十年之内找到。但是,真正意义的超级智能倒是有可能在四、五十年之内诞生。

联合国新闻:从当前来说,我们可能最紧迫的是要去应对生成式人工智能给我们带来的一些挑战。联合国秘书长刚刚组建了最新的高级别人工智能咨询机构,要求在今年年底就要提出初步建议,您如何来理解这种紧迫性?

曾毅:不同发展途径的人工智能,它都存在不同的挑战,并不是说某一种人工智能它就绝对地安全。我认为人工智能安全风险确实是一个全球议题,没有任何一个国家能够单独应对,也不能独善其身。

其实有几个关键的问题,第一个就是人工智能的发展目前不会停止,那么如何更稳健地发展,这个是关键。我们需要的是稳健的发展,而不是野蛮的生长。

那么另外一方面,在发展的过程当中,是不是能够规避相关的风险?包括伦理的问题、安全的问题,这个可能是比发展更急迫的问题。

另外,现在存在的人工智能的超级大国在推进自己的人工智能技术的同时,是不是能够关注到全球人工智能的利益能够共享,特别是对于中低收入国家来说。

联合国新闻:您参加世界互联网大会的时候,列出了一个人工智能发展与治理的体系。您能不能大致介绍一下,哪些是核心的要素?

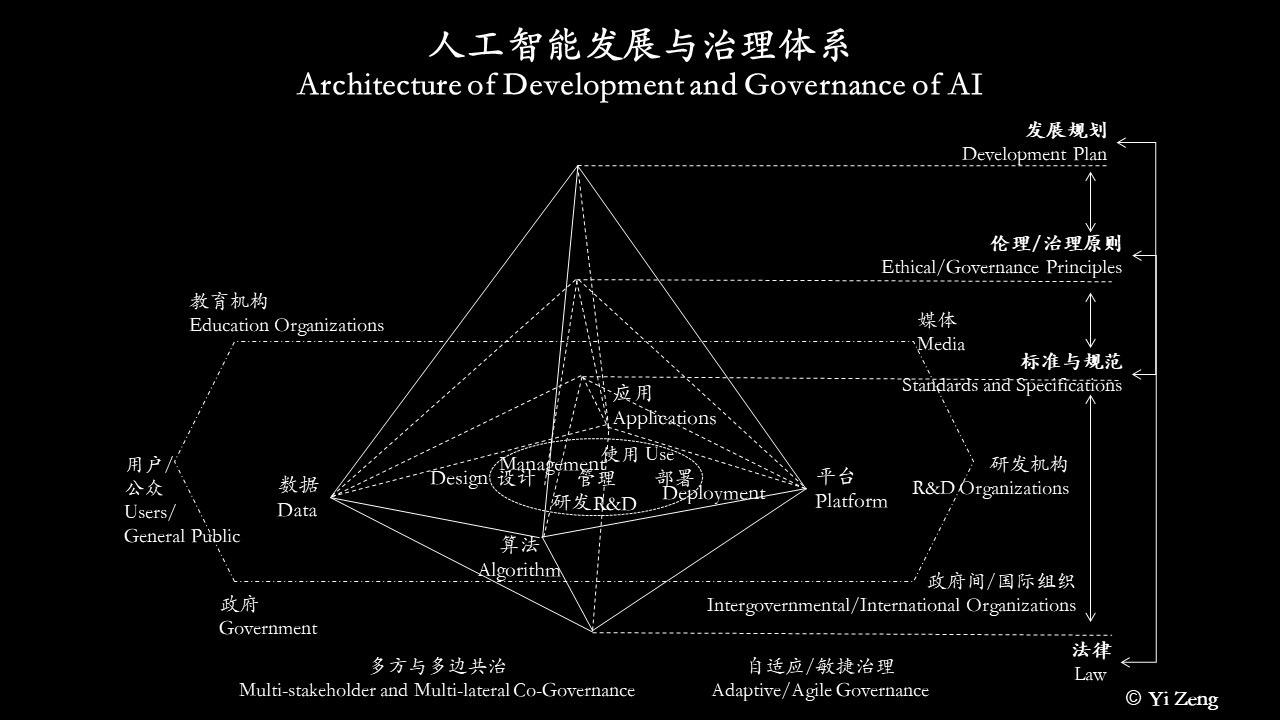

曾毅:我认为,全球的人工智能治理体系是从发展规划开始的,不是说风险防范和伦理安全的问题是滞后的。所以,发展规划是高层的指导。

在下面的是伦理治理原则,作为一个顶层设计,应该是伦理优先的。这个伦理治理原则毕竟是软性的约束,它还不是法律。所以下面一层是标准规范,这跟技术发展结合得更紧密。最后,底线就是法律。

这个层级结构,不管任何一个国家,还是在联合国的层面,都需要考虑到人工智能的发展和治理的不同维度,分别是数据、算法、算力和应用。那么在制定相关的发展规划、伦理安全原则,以及标准和法律的过程当中,这四个维度都需要覆盖到。应该说,在人工智能产品和服务的整个生命周期,从设计、研发、使用、部署、治理到高层的管理都需要这个体系的构建。

那么,在整个体系当中,谁是规则的制定者?政府必然会发挥很多主导作用,企业是必然参与的,学术机构也是必然参与的。但我想另外两个非常重要的就是公众和媒体,公众会反馈需求,媒体会发出适当的声音,帮助公众提升意识。所以,这不仅仅是多利益相关方的,还是多边的人工智能治理。

人工智能的治理还应当具有高度的自适应型。从现在人工智能的发展来看,你制定了相关规定以后,可能半年到一年之内就会出现一些新情况。所以,这种我们叫做自适应的或者是敏捷的治理,实际上是非常关键的。

联合国新闻:那么像联合国这样的一个多边机构,它应该起到什么作用?

曾毅:全球的人工智能治理,一定是政府间组织要扮演非常重要的协调作用。在这个基础之上,任何一个国家在制定这些原则、规范、法律的时候,实际上都需要去关切到这种国际的共识。

我认为,全球人工智能治理从最具包容性和全球协调的角度来说,联合国是唯一值得信赖的机构。现在全球存在着各种政府间的人工智能协调机制,但是如何把这种区域性的人工智能治理协同在一起,我觉得这就是联合国的义务与职责。

我们可以看到,有一些国家和组织,也许并不希望是联合国这个平台来推进全球人工智能治理的议程。但是越是这样的组织,在我看来越难以信任。

我认为,联合国的全球治理挑战巨大。如何去平衡区域之间的利益,如何去找到这种共同的价值,如何在发展的过程当中更大范围地去避免可能的风险,每一步都是举步维艰的。

联合国新闻:最后我就想了解一下,这个(人工智能)咨询机构具体的工作方式是什么样的?

曾毅:我们的专家组开始分为不同的工作组,就是将39个人按不同的这个议题分组。然后,在每一个专家组当中都需要考虑到一些共同的挑战,比如说可能的风险及其规制的问题,比如说性别平等的问题,再比如说文化的传承、交互和互鉴的问题。

我们现在基本上每周都会召开线上的工作组会议。那么到今年年底的时候,我们会拿出一个非常初步的报告,其中会涵盖对于人工智能的发展风险以及治理模式的认知。可能从明年初开始,就要进行广泛的意见征集,以及进一步的修正和优化的工作。

联合国新闻:那么在这份初步的报告中,您最大的投入会是什么?

曾毅:我非常关注人工智能推进文化的交互和互鉴。因为我认为,现在世界很多时候在我们看来如此割裂,其实是由于文化的差异引起的。但是,文化之间并不存在绝对的隔阂,实际上很多文化之间存在关联。所以,我认为人工智能作为一种赋能的工具,应该促进文化的交互和互鉴。

另外,我想这个专家组到年底之前非常重要的议题,就是把人工智能治理不同的模式梳理清楚。比如说,联合国是不是需要有一个专门的机构来协调全球的人工智能工作,还是说我们依赖于现在不同的国家或者其他的政府间组织就可以了。我觉得不同的可能性要呈现给全球的公众,针对不同的可能性遇到的挑战和机遇也要让大家理解。

联合国新闻:所以这一点还需要咨询机构来做论证,现在还没有一个结论?

曾毅:我认为现在还没有结论。即使专家组层面达成了一致,在全球的层面还需要经过明年未来峰会上各国的磋商。我想,每一步可能都是一个挑战。

以上是《联合国新闻》的邹合义在北京对中科院类脑智能研究专家曾毅所做的采访。